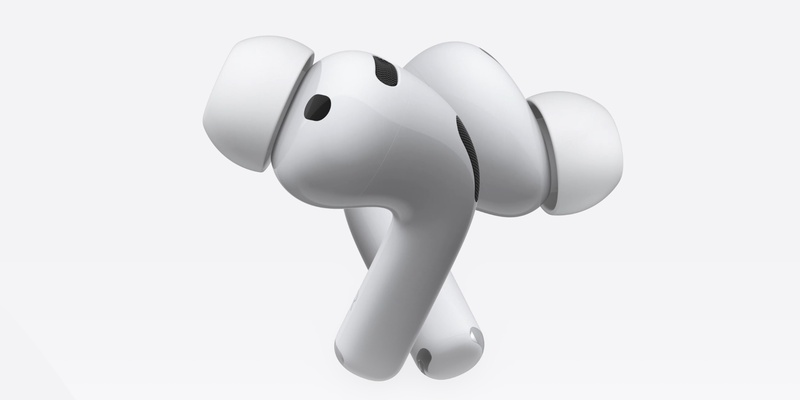

AirPodsPro摄像头方案深度解析:苹果正在将耳机变成下一代AI交互入口

2019年,我第一次拿到AirPodsPro。降噪、通透、空间音频——这些功能在当年看来已经足够惊艳。但七年后的今天,当产业链传出红外摄像头方案时,我才意识到:苹果对耳机的定义,早已超越「音频设备」本身。

从降噪耳机到空间感知终端的范式转移

红外摄像头的引入,本质上是将AirPodsPro从输出设备转型为输入设备。传统耳机的交互逻辑是单向的——你发出指令,设备执行。但当你戴上具备视觉感知能力的耳机,Siri看到的和你看到的开始同步。这意味着什么?意味着耳机第一次具备了「理解场景」的能力。

具体场景可以这样想象:你在街头询问「这家餐厅怎么样」,Siri调取的是摄像头捕捉到的招牌、评分、人流密度,而非依赖你口述位置信息。这种信息获取效率的量级提升,才是IR摄像头的核心价值。

手势交互替代按压:一场迟到的交互革命

压感柄交互是AirPodsPro的核心设计,但物理按压存在根本局限:需要手指精确接触、力反馈难以量化、冬季戴手套几乎失效。苹果测试手势操作的目标很明确——用计算机视觉识别手部动作,实现无接触控制。

技术路径上,红外摄像头负责捕捉手部轮廓与运动轨迹,H3芯片处理实时图像帧,配合iOS27的新Siri完成意图解析。这套方案的技术难度远超外观改动,但一旦成熟,将重新定义可穿戴设备的交互范式。

H3芯片的性能跃升与延迟控制

H3芯片相比H2的升级并非单纯算力堆砌。从已知信息推断,H3的重点改进方向有两个:其一是降低音频处理延迟,其二是支撑AI推理负载。前者影响交互响应速度,后者决定场景理解的深度。两者结合,才能让红外摄像头的价值真正落地。

对于开发者而言,这意味着下一代AirPodsAPI可能开放更多传感器数据接口。耳机不再只是音频播放终端,而是可穿戴设备矩阵中的感知节点。

购买决策的量化框架

如果你关注AI能力且手持iPhone16Pro以上的设备,AirPodsPro新品值得等待,发布时间节点预计与iOS27同步。如果你的使用场景集中在通话、音乐、通勤降噪,现款AirPodsPro的体验已经非常成熟,升级感知有限。国内用户还需额外考虑AppleIntelligence的落地进度——这是新功能完整性的必要条件。