技术解析:英特尔ArcPro驱动突破内存调用瓶颈,93%系统内存如何重塑本地AI推理格局

三年前,我在搭建本地AI开发环境时,被显存容量死死卡住。那时候主流消费级显卡最大显存不过8GB,而大语言模型的推理对显存需求动辄数十GB。折腾半天,最后不得不转向云端API,失去了对模型和数据的完全控制。

内存分配策略的范式转移

英特尔最新发布的ArcPro系列HotFix驱动(版本302.0.101.8517,代号Q1.26R2)彻底改变了这一局面。驱动将GPU可调用的系统内存比例从87%大幅提升至93%,这6个百分点的提升在实际应用中意味着什么?

以32GB系统内存配置为例:旧驱动下GPU可用内存约为28GB,新驱动下可分配约30GB,净增2GB。以64GB系统内存为例:GPU可获得约59.5GB可用显存(64×0.93),足够加载更大规模的模型进行本地推理。

技术规格与兼容矩阵

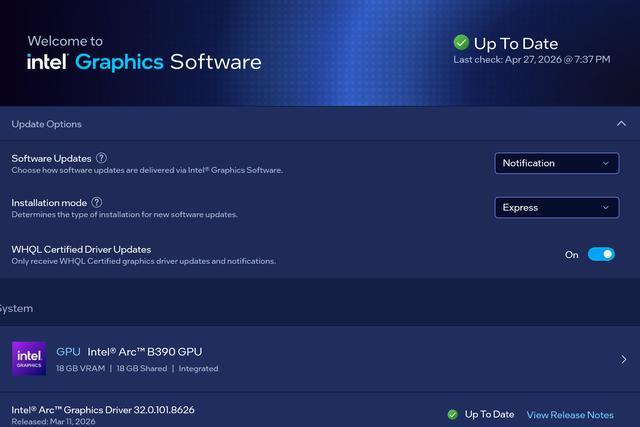

本次更新覆盖的硬件范围相当广泛。基于Alchemist和Battlemage架构的专业显卡——包括ArcProB390、ArcProB370等——均获得支持。处理器端则涵盖CoreUltra品牌全系,采用MeteorLake、LunarLake、ArrowLake-S、ArrowLake-H与PantherLake架构的产品。

操作系统兼容性同样完善:Windows1064位22H2更新,以及Windows1164位从21H2到25H2的所有主要版本均被纳入支持范围。这保证了企业用户平滑升级的可能。

与AMDRyzenAI平台的正面交锋

横向对比AMDRyzenAI平台,当前最高内存分配比例为87%。在128GB系统内存的AIMAX+平台上,GPU可获得约112GB可用内存。英特尔93%的分配比例在比例上占优,但AMD在绝对容量上仍保持领先。这场围绕内存资源分配效率的竞争才刚刚开始。

实际应用场景的价值落地

对于开发者而言,本地运行大模型意味着数据不必离开本地环境,隐私安全性得到保障;对于内容创作者,可以离线进行AI辅助创作,不依赖网络连接;对于企业用户,降低了云端API的长期使用成本。英特尔此次策略调整精准命中这些需求痛点。